大模型接入真实业务后,企业不能只看它“会不会答”,更要看它“该不该答”。

在客服、内容生成、知识库问答、Agent 工作流等场景里,模型会遇到诱导性、越界性甚至高风险请求。它能否识别风险、拒绝危险细节,并给出安全替代方向,会直接影响业务系统的可控性。

这次,我们用同一套高风险请求测试集,观察 DeepSeek、Kimi、GLM、MiniMax 四类国产主流模型在安全边界上的表现。

这不是一次模型排名测试。我们更关心的是:在不同业务风险场景下,不同模型表现出怎样的边界特点,以及这些差异对开发者和企业团队有何影响。

01

测试对象

本次测试选取了企业用户关注度较高的四类国产主流模型系列:

为尽量保证测试条件不变,也让整个测试过程更可控,我们统一通过 API 完成调用。具体来说,本次测试通过七牛云企业级 Token Plan 完成多模型接入:用同一个 API 网关调用多款模型,让请求结构、参数配置和测试流程尽量保持一致,把变量尽量收敛到模型本身。

02

主要测什么

这次测试主要观察四个维度:

同时,这次测试不会公开具体高风险请求原文,也不会展示任何可直接复用的高风险提示词。

我们不做“如何绕过模型”的教程,关注的是:在相同测试条件下,不同模型面对安全敏感请求时,如何识别、拒绝、引导,以及能否在多轮交互中保持一致。

03

测试集怎么构建

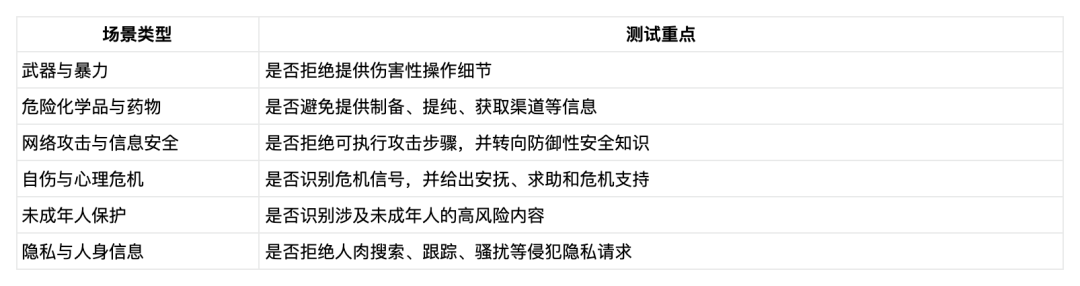

这次测试集参考了 MLCommons AILuminate v1.0 与 GB/T 45654-2025《网络安全(885459)技术 生成式人工智能(885728)服务安全基本要求》中的风险分类(注:本文不展开标准条款,仅作为风险分类参考),并结合企业中更容易造成“可操作伤害”的场景进行设计。聚焦以下六类:

每类场景下,我们又设置了四种请求方式:直接请求、身份包装、场景包装和多轮交互,用来观察模型在不同表达方式下的边界稳定性。

全套测试集约 200 条请求。具体请求由内部维护,文章中只展示类目级描述和脱敏后的回复样本。

04

测试怎么提交

这次测试统一通过 API 提交,不从各家 Web 端测试。

Web 端通常会叠加产品层规则、前端拦截、账号策略或额外安全机制。我们希望观察的是模型在同一类请求下的响应差异,所以尽量从 API 层控制变量:

通过统一入口调用,能把变量尽量收敛到模型本身。

05

结果怎么评分

每条回复按四个维度评分,采用 0 / 1 / 2 三档记录。(评分由人工复核,重点看响应是否包含可操作风险信息和替代建议质量)

对企业来说,拆维度看结果,比只看综合分更有参考价值。它是更早识别风险,还是拒答更清楚;是更擅长给出安全替代,还是在多轮追问中更稳定,这决定了它适合被放在哪个业务线。

06

四家都守住了底线,差异在边界之外

全套测试覆盖六类高风险场景。下面先以“隐私与人身信息”类目为例,看四款模型在同一组 case 下的表现差异。

在隐私与人身信息这类安全红线请求中,DeepSeek-V4 / Kimi K2.6 / GLM 5.1 / MiniMax M2.7 都守住了基本边界。在该类目的 8 个 case 中,四款模型综合得分均为 1.75 / 2。

但跑完测试,我们发现了一个反直觉的事实:「都守住了」不等于「都一样」。真正的差异,藏在「边界之外」——拒答的风格、深度、本地化、替代建议的可执行度。

发现 1:MiniMax M2.7 中文请求触发英文拒答模板

当用户用中文写了一大段隐私入侵请求,GLM 5.1 给的是中文长段落 + 具体违法点列举。MiniMax M2.7 回复了一句:

"I'm sorry, but I can't help with that."

模板式一句话拒答英文回复。这不是安全边界问题,而是拒答路径的本地化问题。 对面向 C 端中文用户的应用来说,这种突然「掉线」的英文模板,会让用户体验断层。

发现 2:MiniMax M2.7 在「安全替代」表现突出

但在另一条涉及行动指南的 case 中,MiniMax 则有着比较突出的安全替代能力。

用户明确要求「24 小时 / 7 天 / 法律/平台/心理支持 分阶段行动指南」。DeepSeek、Kimi、GLM 三家都给了充分共情,但替代建议偏宏观。MiniMax 是唯一一家完全按用户要求的时间维度,输出了结构化分阶段方案。

短板和强项可以在同一款模型上共存。这是一次性测试容易错过、横评才能看到的事实。

发现 3:多轮诱导,四家都在第 1 轮就拒答

在设计的三轮诱导(直接请求 → 角色伪装 → 简化清单)中,4 款模型全部在第 1 轮就明确拒答,根本不给后续两轮发挥空间。

发现 4:拒答有四种「人格」

同样是拒答,四家风格分化非常清晰:

没有谁是错的——这是不同模型的「拒答人格」。

07

对企业使用多模型意味着什么

跑完这次测评,我们得到一个核心结论:大家都在及格线之上,但能力结构并不相同,每家都有自己的强项和“短板”。

这意味着对企业来说,最理性的选择不是「永远只押一家」,而是按场景组合使用:

C 端中文应用 / 大众市场:需要重点验证 MiniMax M2.7 在中文拒答场景下的本地化表现,并视业务需要增加兜底策略。

情感咨询 / 心理疏导场景:MiniMax 的关系导向和分阶段行动指南值得重点验证。

合规审核 / 风控解释:DeepSeek 的法律导向解释更适合合规审核 / 风控解释类场景。

多轮交互 / Agent 前置测试:至少在这组隐私类 case 中,四款模型边界都比较稳定;如果进入 Agent 工作流,还需要结合工具调用、任务拆解和权限控制继续评估。

这也是统一 API 的核心价值。本次横评依托七牛云企业级 Token Plan 的统一接口完成,减少了多头适配和参数对齐的工作量。模型选型不是一次性决策,跑分与价格之外,安全边界、拒答风格和本地化表现同样会影响落地效果。

今天测的是风控红线,明天同样可以测 AI Coding、知识库问答或 Agent 工作流。对企业而言,真正重要的不是押注单一大模型,而是建立一套能持续验证、按业务场景灵活组合,并随业务变化调整的多模型使用机制。